Darktrace podaje, że 74% specjalistów ds. bezpieczeństwa IT twierdzi, że ich organizacje odczuwają poważne skutki zagrożeń związanych ze sztuczną inteligencją.

Sztuczna inteligencja to jedna z najszybciej rozwijających się technologii współczesnego świata z szerokim zastosowaniem od edukacji po rozrywkę.

W artykule opisuję główne zagrożenia AI oraz jak bezpiecznie z niej korzystać.

Spis treści:

Toggle

Jakie są główne zagrożenia sztucznej inteligencji?

Sztuczna inteligencja zagrożenia – uchroń się przed nimi! W dyskusjach branżowych często używa się zamiennie terminów “al inteligencja” i “sztuczna inteligencja”, jednak niezależnie od nazewnictwa, zagrożenia pozostają realne.

Przeglądając raporty dotyczące al inteligencja i nowoczesnych systemów uczących się, mogę zdecydowanie wskazać kilka najważniejszych dziedzin, które może zmienić użytkowanie AI.

Wspomniane wyżej Darktrace (pionier w zakresie bezpiecznego wdrażania AI) przeprowadziło kolejny raport związany z podejściem do sztucznej inteligencji w 2025 roku. Firma zapytała 1500 profesjonalistów z zakresu cyberbezpieczeństwa o ich nastawienie do AI i zrozumienie tej nowoczesnej technologii.

Dane wskazują, że 45% z nich nie czuje się dobrze przygotowana na rzeczywistość cyber zagrożeń ze strony sztucznej inteligencji.

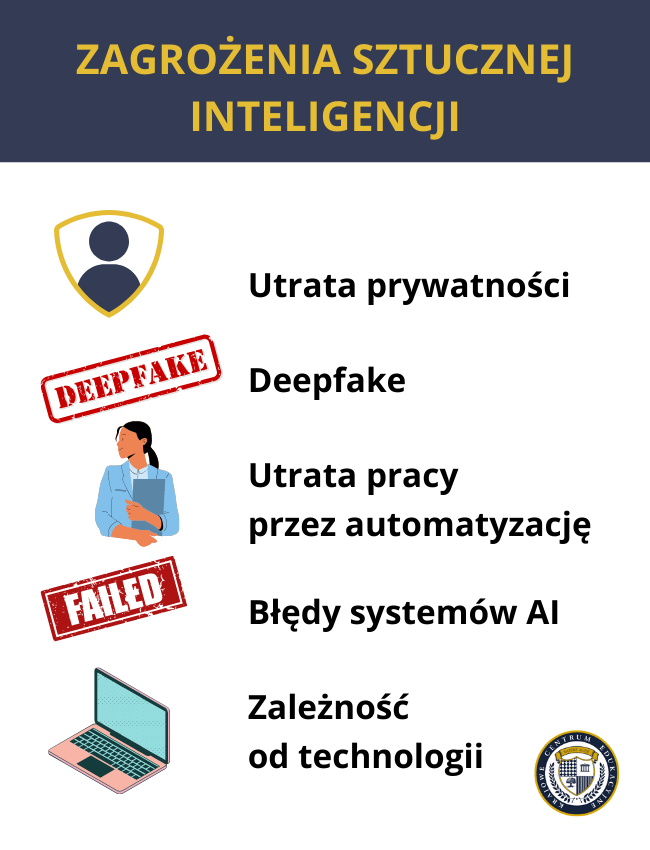

Utrata prywatności

Jednym z największych zagrożeń związanych z AI jest naruszenie prywatności. Systemy AI często opierają się na ogromnych ilościach danych, w tym danych osobowych. Jeśli te dane zostaną niewłaściwie zabezpieczone lub wykorzystane, może dojść do poważnych naruszeń prywatności.

Przykładem są systemy rozpoznawania twarzy, które mogą być wykorzystywane do inwigilacji.

Deepfake – manipulacja rzeczywistością

Jak podają badania Deep Instinct, 61% organizacji odnotowało wzrost liczby ataków deepfake w ciągu ostatniego roku.

Deepfake to technologia, która wykorzystuje AI do tworzenia realistycznych, ale fałszywych:

- obrazów,

- animacji zdjęć,

- nagrań wideo,

- konferencji lub transmisji na żywo,

- nagrań dźwiękowych.

Jest to jedno z największych zagrożeń związanych z AI, ponieważ może być wykorzystywane do dezinformacji, manipulacji opinią publiczną, a nawet szantażu. Fałszywe nagrania mogą wpływać na wyniki wyborów, niszczyć reputację osób lub prowadzić do konfliktów społecznych.

Automatyzacja i utrata miejsc pracy

Exploding Topics informuje, że do końca dekady 14% pracowników zostanie zmuszonych przez sztuczną inteligencję do zmiany kariery.

AI coraz częściej zastępuje ludzi w różnych zawodach, co prowadzi do obaw o utratę miejsc pracy. Chociaż automatyzacja zwiększa wydajność pracowników, może również pogłębić nierówności społeczne i pozostawić wiele osób bez środków do życia.

Szczególnie zagrożone są zawody oparte na powtarzalnych zadaniach, takie jak praca na produkcji czy w logistyce.

“Jeśli ktoś chce zostać senior programistą, będzie wpisywał polecenia do sztucznej inteligencji, zamiast samodzielnie programować. To może skutkować brakiem nowych programistów za kilka lat”.

Komentuje wyzwania związane z AI, Mirosław Skwarek, autor wielu książek biznesowych i właściciel firmy eBiznes PROFIT.

Błędy i nieprzewidywalność komputerowej inteligencji

Systemy AI, choć zaawansowane, nie są doskonałe. Mogą popełniać błędy, szczególnie gdy są uczone na niekompletnych lub stronniczych danych. Przykładem są systemy rekrutacyjne, które mogą dyskryminować pewne grupy społeczne ze względu na nieprawidłowo dobrane dane treningowe.

Ponadto, AI może działać w sposób nieprzewidywalny, co stanowi zagrożenie w przypadku zastosowań krytycznych, takich jak medycyna czy transport. Narzędzie wciąż nie jest doskonałe i raczej zawsze będzie potrzebowało człowieka, który będzie je wzmacniał i kontrolował.

Zależność od technologii

Coraz większa zależność od AI może prowadzić do sytuacji, w której awaria systemu lub cyberatak sparaliżują kluczowe sektory takie jak:

- energetyka,

- Transport,

- czy służba zdrowia.

Społeczeństwa stają się coraz bardziej podatne na tego typu zagrożenia. Moim zdaniem to też kwestia przyzwyczajenia się do stosowania AI w wielu dziedzinach życia. Zamiast sprawdzania jej wydajności, duża część społeczeństwa ślepo ufa nowoczesnej technologii i powierza jej codzienne zadania.

Bezpieczne korzystanie z AI – jak robić to z głową?

Aby minimalizować zagrożenia związane z AI, konieczne jest wprowadzenie odpowiednich regulacji i standardów. Poniżej wyszczególniłem kilka kluczowych kroków, które mogą pomóc w bezpiecznym korzystaniu z tej technologii.

1. Etyka i regulacje prawne

Konieczne jest opracowanie międzynarodowych standardów etycznych i prawnych dotyczących rozwoju i stosowania AI. Powinny one obejmować zasady przejrzystości, odpowiedzialności i ochrony prywatności. Sztuczna inteligencja zagrożenia stanowi istotny punkt w dyskusji o przyszłości rozwoju technologii.

Jest to niezwykle trudna dziedzina prawna, ale możemy mieć nadzieję na wyklarowanie się zasad używania sztucznej inteligencji w niedalekiej przyszłości. Przykładowo, już teraz UE nakłada na użytkowników ograniczenia w postaci niemożliwości korzystania z wszystkich funkcji Apple Intelligence w najnowszych Iphone’ach.

2. Bezpieczeństwo danych

Firmy i instytucje korzystające z AI muszą inwestować w zaawansowane systemy zabezpieczeń, aby chronić dane przed wyciekami i cyberatakami. Kluczowe jest również ograniczenie gromadzenia danych do niezbędnego minimum.

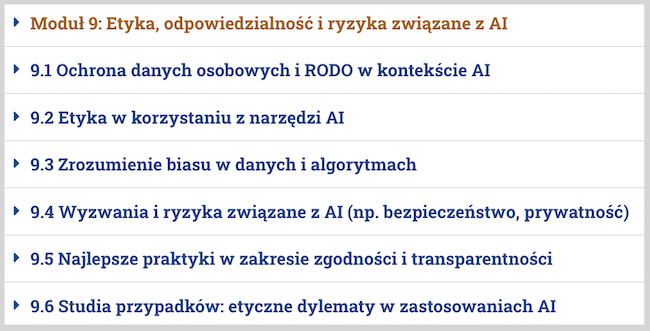

3. Edukacja i świadomość społeczna

Społeczeństwo musi być świadome zagrożeń związanych z AI, takich jak deepfake czy dezinformacja. Edukacja w zakresie krytycznego myślenia i weryfikacji informacji może pomóc w przeciwdziałaniu manipulacjom.

A jeśli o edukacji mowa, polecam zajrzeć do naszego panelu szkoleń KCE, w którym możesz znaleźć m.in kursy dotyczące bezpiecznego wykorzystania nowoczesnych technologii w swojej pracy.

4. Nadzór nad inteligentnymi systemami

Systemy AI, szczególnie te stosowane w kluczowych sektorach, powinny być poddawane regularnym audytom i testom, aby zapewnić ich niezawodność i bezpieczeństwo. Ważne jest również, aby zawsze pozostawiać ostateczną decyzję w rękach człowieka, zwłaszcza w przypadku zastosowań o wysokim ryzyku.

Pozytywnym aspektem jest także wzrost zapotrzebowania na pracę specjalisty AI. To stosunkowo nowe miejsce pracy, na które już teraz rośnie zapotrzebowanie.

5. Współpraca międzynarodowa

Zagrożenia związane z AI mają globalny charakter, dlatego konieczna jest współpraca między państwami, organizacjami międzynarodowymi i sektorem prywatnym. Tym bardziej, że znaczna część rynku przeniosła się do internetu, w którym nie ma wyraźnego podziału narodowościowego.

Podsumowując, jedynie wspólne działania mogą skutecznie zapobiec nadużyciom i zapewnić zrównoważony rozwój AI.

Zagrożenia związane z rozwojem AI – FAQ

Poniżej opisałem kilka zagadnień, które są często wyszukiwane odnośnie do ryzyka dotyczącego działania inteligentnych systemów.

1. Czy AI może stać się niebezpieczne dla ludzi?

Tak, sztuczna inteligencja może stać się niebezpieczna, szczególnie jeśli nie będzie odpowiednio kontrolowana. Zagrożeń spowodowanych jej niewłaściwym użyciem jest wiele.

Począwszy od dezinformacji i utraty prywatności po nadmiernym poleganiu na systemach AI, które będąc wadliwe, mogą prowadzić do poważnych konsekwencji w medycynie, transporcie czy energetyce. Dlatego kluczowe jest wprowadzenie regulacji i nadzoru, aby minimalizować te ryzyka.

Sztuczna inteligencja zagrożenia wymaga pogłębionej analizy przez specjalistów cyberbezpieczeństwa.

Co robić, aby być świadomym użytkownikiem AI?

Z mojej strony chciałbym, żebyś starał się czytać regulaminy użytkowania systemów AI i zwracał uwagę na to, w jaki sposób korzystasz z nowoczesnych technologii. Warto szkolić się w tym zakresie, aby uniknąć nieprzyjemnych konsekwencji.

Z kolei Aleksandra Bielat, specjalistka ds. ochrony danych oraz sztucznej inteligenji, komentuje, że:

“W najbardziej „wrażliwych” sytuacjach, proces decyzyjny powinien zachodzić pod kontrolą człowieka, i to człowiek powinien mieć na niego największy wpływ”.

2. Jakie zawody są najbardziej zagrożone przez AI?

Najbardziej zagrożone są zawody oparte na powtarzalnych zadaniach, takie jak praca na produkcji, logistyka, obsługa klienta czy prosta analiza danych.

AI może również wpływać na zawody kreatywne (np. pracę grafika, copywriting), znacznie upraszczając produkcję tekstów czy grafik, oraz sektory prawnicze i finansowe, gdzie automatyzacja może zastąpić część obowiązków.

3. Jak mogę chronić swoje dane przed nadużyciami związanymi z AI?

Aby chronić swoje dane, warto przede wszystkim:

- stosować silne hasła,

- korzystać z uwierzytelniania dwuskładnikowego (np. hasłem i potwierdzeniem przez e-maila czy numer telefonu lub logowaniem biometrycznym),

- unikać udostępniania wrażliwych informacji w sieci,

- oraz regularnie aktualizować oprogramowanie.

Pamiętaj także o ograniczeniu korzystania z usług, które wymagają nadmiernego dostępu do danych osobowych.

4. Czy AI może być używana w sposób bezpieczny w edukacji?

Tak, AI może być bezpiecznie wykorzystywana w edukacji, np. do:

- personalizacji nauki,

- nauki online,

- automatyzacji oceniania,

- pomoc uczniom w rozumieniu konkretnych przedmiotów,

- czy wsparcia nauczycieli.

Ważne jest jednak, aby systemy AI były przejrzyste, wolne od stronniczości i chroniły dane uczniów. Przede wszystkim w tej dziedzinie, to nadzór człowieka nad procesem edukacyjnym powinien pozostać kluczowy, a nie zastąpiony sztuczną inteligencją.

5. Jakie zagrożenia niesie sztuczna inteligencja dla dzieci i młodzieży?

AI może stanowić zagrożenie dla dzieci i młodzieży poprzez:

- szerzenie dezinformacji,

- treści manipulacyjne,

- cyberprzemoc,

- czy nadmierne uzależnienie od technologii.

Niestety ze względu na to, że młodzież często nie czyta regulaminów, istnieje również duże ryzyko naruszenia ich prywatności. Sztuczna inteligencja zagrożenia staje się częstym tematem debat etycznych wśród ekspertów technologicznych.

Aby zminimalizować te zagrożenia, warto już od najmłodszych lat edukować młodzież w zakresie chronienia swoich danych osobowych i bezpiecznego korzystania z nowych technologii.

6. Czy AI inteligencja i sztuczna inteligencja to to samo?

Terminy “AI inteligencja” i “sztuczna inteligencja” są często używane zamiennie. Oba odnoszą się do systemów komputerowych zaprojektowanych do wykonywania zadań wymagających ludzkiej inteligencji. Niezależnie od nazewnictwa, kluczowe jest zrozumienie zagrożeń, jakie niesie ta technologia, oraz wdrażanie odpowiednich zabezpieczeń.

Potencjalne skutki uboczne korzystania z AI – podsumowanie

Rozwój sztucznej inteligencji może przynieść ogromne korzyści, ale również stanowi poważne zagrożenia. Deepfake, utrata prywatności, automatyzacja czy broń autonomiczna to tylko niektóre z wyzwań, przed którymi stoimy.

Kluczowe zagrożenia, które wymagają natychmiastowej uwagi:

- deepfake i dezinformacja – mogą destabilizować demokrację i niszczyć reputacje w ciągu godzin,

- utrata prywatności – systemy inwigilacji AI przekraczają granice ludzkiej godności,

- masowa automatyzacja – 14% pracowników zmusi do zmiany kariery do końca dekady,

- nieprzewidywalność systemów – błędy AI w medycynie czy transporcie mogą kosztować życie,

- zależność technologiczna – awarie mogą sparaliżować kluczowe sektory gospodarki.

Aby korzystać z AI w sposób bezpieczny i odpowiedzialny, konieczne jest wprowadzenie odpowiednich regulacji, inwestycje w bezpieczeństwo oraz edukacja społeczeństwa. Więcej na ten temat możesz dowiedzieć się w naszym kursie AI.

Droga do bezpiecznej przyszłości z AI wymaga trzech fundamentalnych działań:

- regulacje prawne – międzynarodowe standardy etyczne i systemy odpowiedzialności,

- inwestycje w cyberbezpieczeństwo – zaawansowane zabezpieczenia danych i systemy audytu,

- edukacja społeczna – krytyczne myślenie i świadomość zagrożeń wśród użytkowników.

A jeśli ciekawi Cię ten temat i interesujesz się wykorzystywaniem nowoczesnych technologii w swojej pracy, sprawdź nasz wpis na temat pisania skutecznych promptów AI.